分布式缓存

概述

本地缓存问题:每个微服务都要有缓存服务、数据更新时只更新自己的缓存,造成缓存数据不一致

解决方案:分布式缓存,微服务共用 缓存中间件(例如redis)

高并发下缓存失效问题–缓存击穿、穿透、雪崩

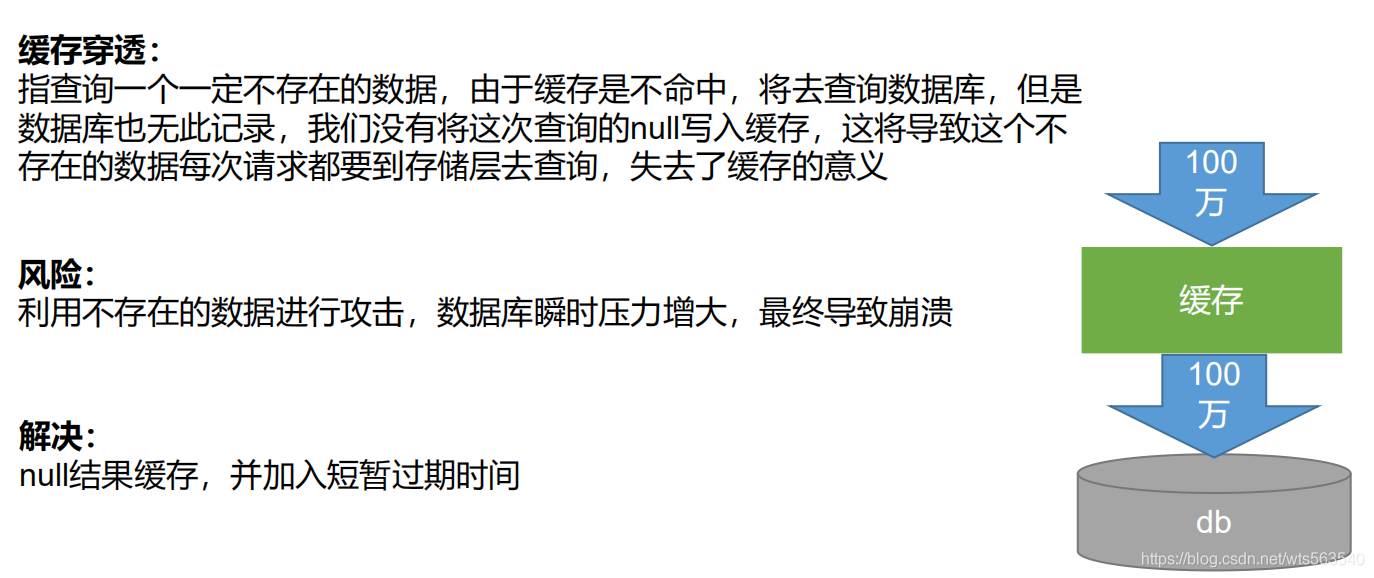

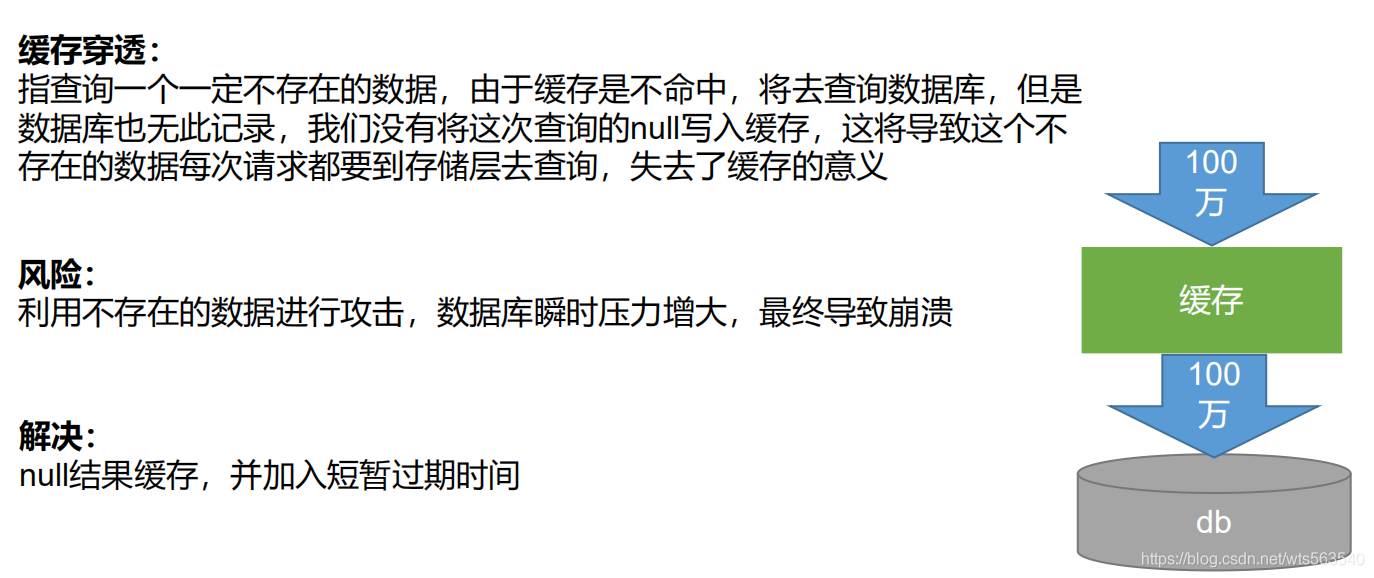

缓存穿透

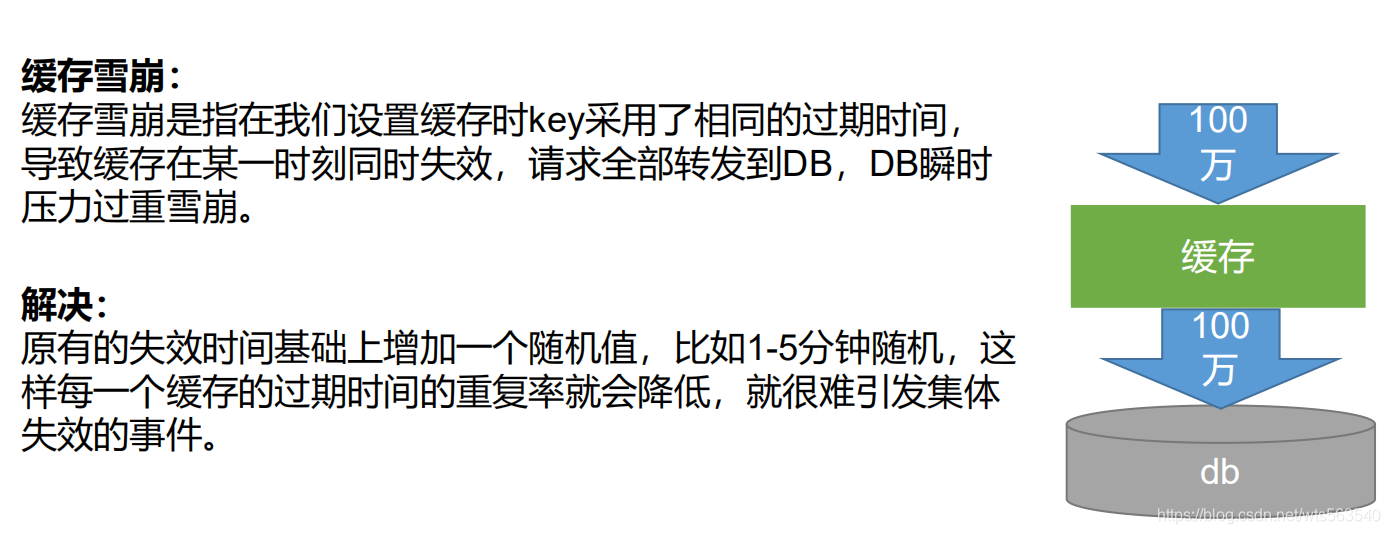

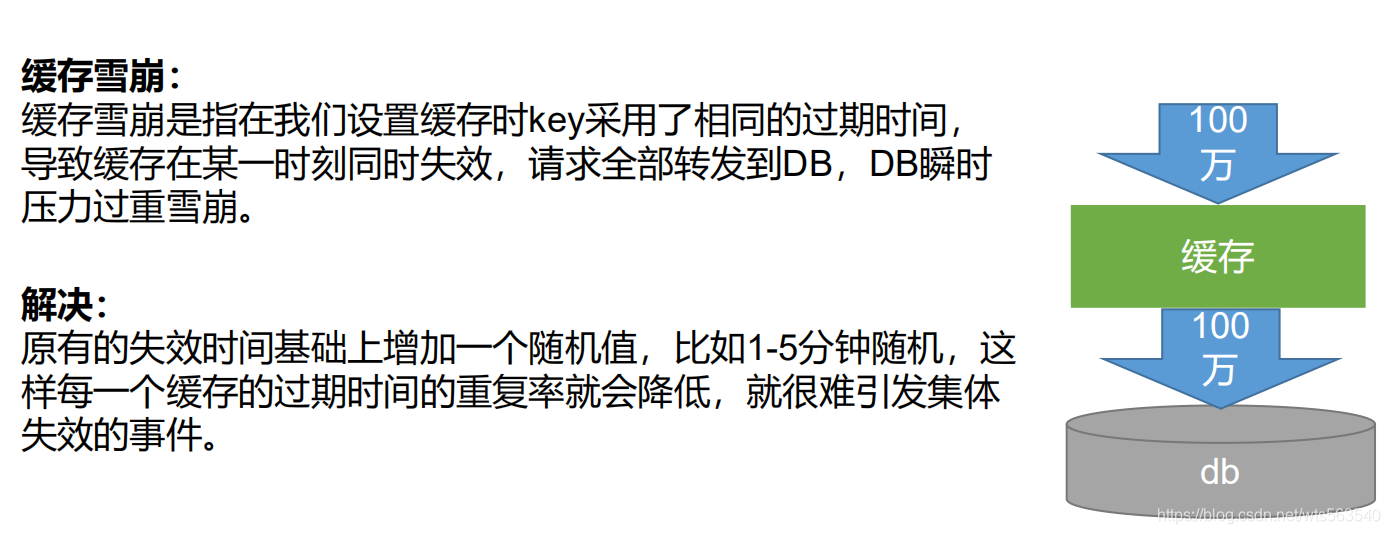

缓存雪崩

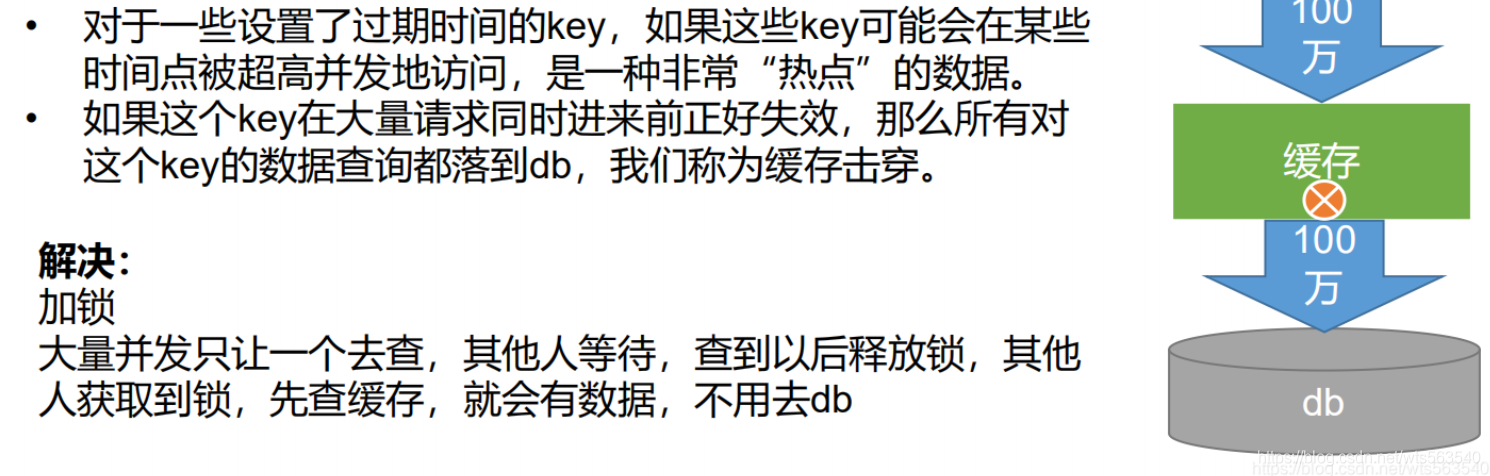

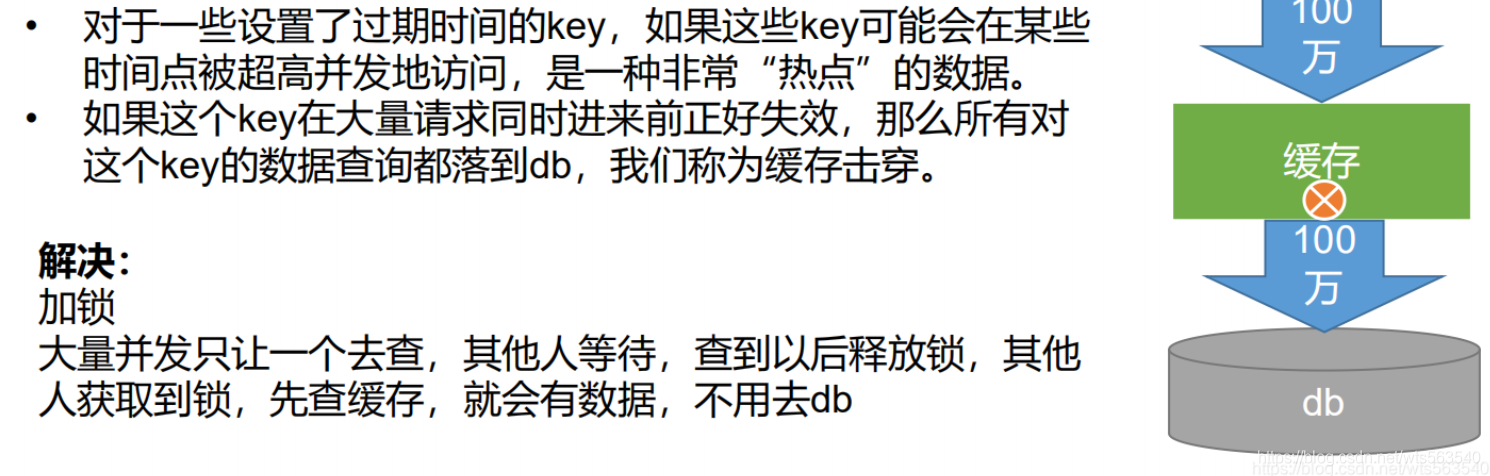

缓存击穿

简单来说:缓存穿透是指查询一个永不存在的数据;缓存雪崩是值大面积key同时失效问题;缓存击穿是指高频key失效问题;

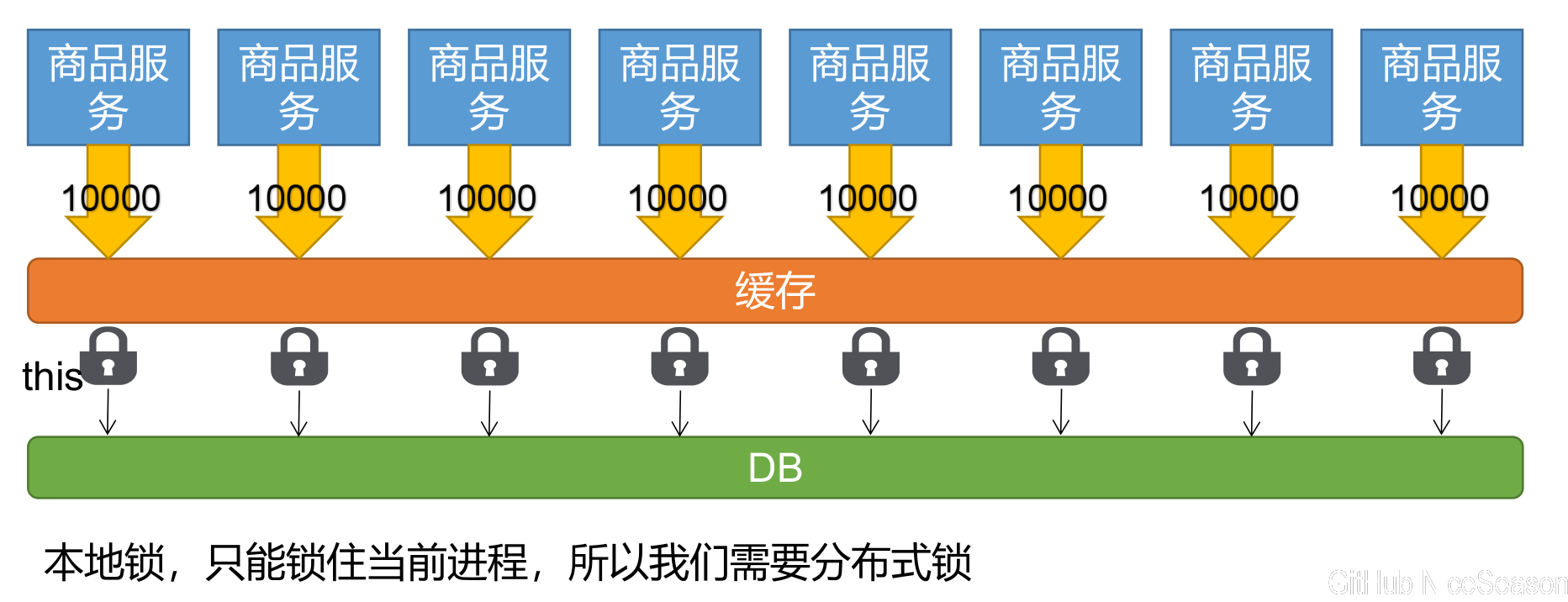

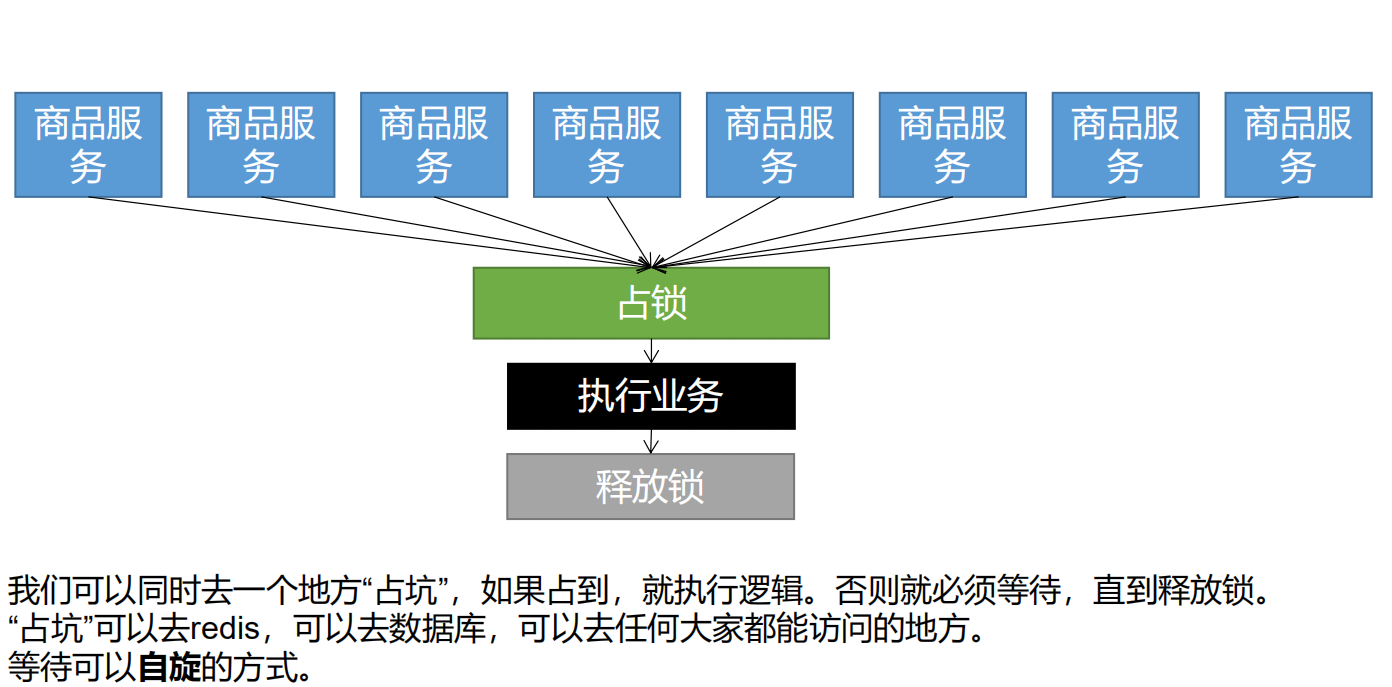

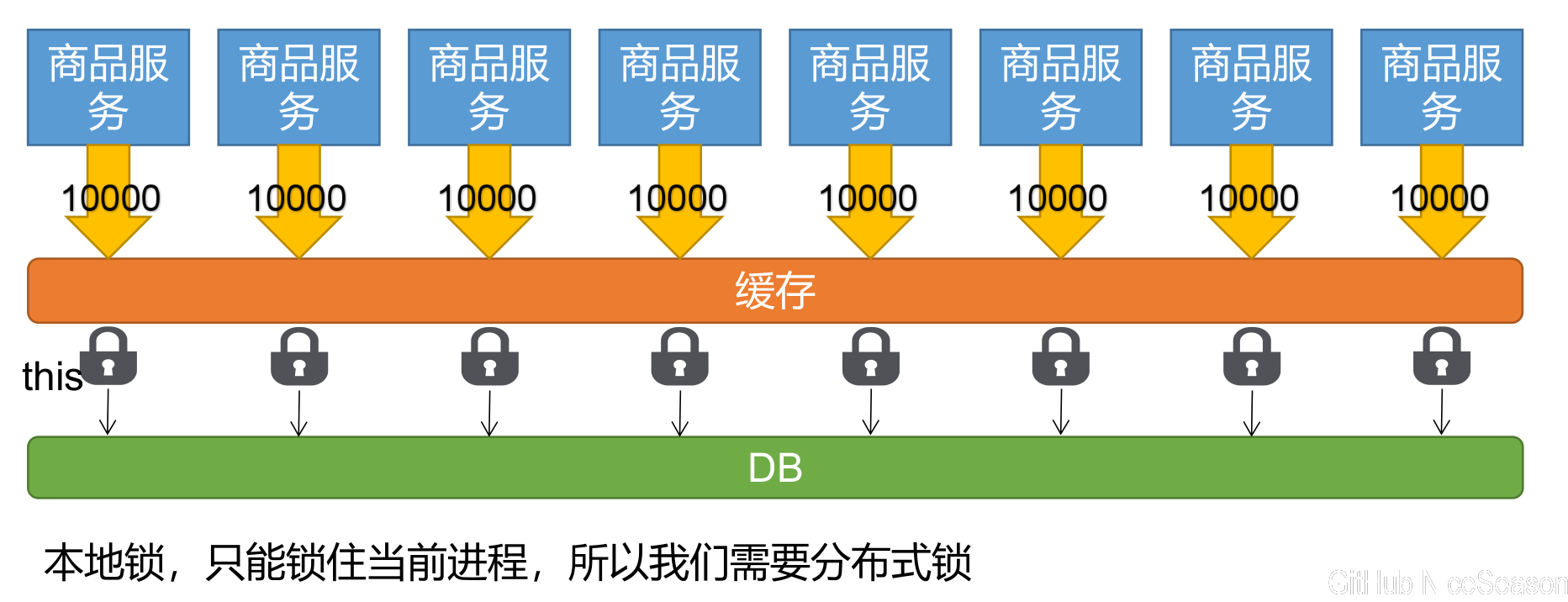

我们可以通过加锁来解决缓存击穿问题。但是本地锁只在当前进程(一台设备)上有效,无法实现在分布式环境下锁住其他设备的相同操作。

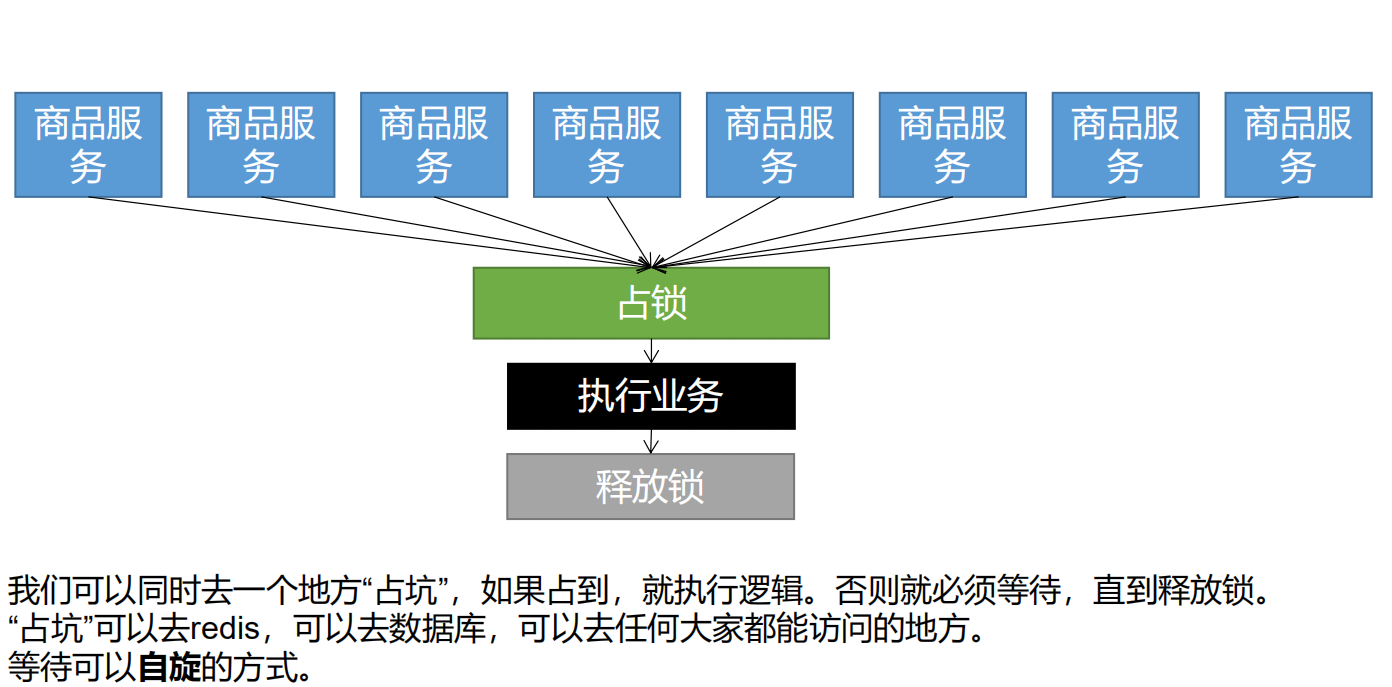

这个时候我们就需要使用分布式锁

分布式锁

在分布式项目中,本地锁只能锁住当前服务,需要分布式锁

redis分布式锁的原理:setnx,同一时刻只能设置成功一个。前提,锁的key是一定的,value可以变。没获取到锁阻塞或者sleep一会

问题1:设置好了锁,如果服务出现宕机,没有执行删除锁逻辑,这就造成了死锁

解决方案:设置过期时间

问题2:业务还没执行完锁就过期了,别人拿到锁,自己执行完去删了别人的锁

解决方案:锁续期(redisson有看门狗)

问题3: 删锁的时候明确是自己的锁。如uuid,判断uuid对了,但是将要删除的时候锁过期了,别人设置了新值,那删除了别人的锁

解决方案:删除锁必须保证原子性(保证判断和删锁是原子的)。使用redis+Lua脚本完成,脚本是原子的

1

2

3

4

5

6

| if redis.call("get",KEYS[1]) == ARGV[1]

then

return redis.call("del",KEYS[1])

else

return 0

end;

|

1

2

3

4

| stringRedisTemplate.execute(

new DefaultRedisScript<Long返回值类型>(script脚本, Long.class返回值类型),

Arrays.asList("lock"),

lockValue);

|

官方文档

gulimall项目中获取二三级分类json数据的分布式锁demo:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

| public Map<String, List<Catalog2Vo>> getCatalogJsonDbWithRedisLock() {

String uuid = UUID.randomUUID().toString();

ValueOperations<String, String> ops = stringRedisTemplate.opsForValue();

Boolean lock = ops.setIfAbsent("lock", uuid,500, TimeUnit.SECONDS);

if (lock) {

Map<String, List<Catalog2Vo>> categoriesDb = getCategoryMap();

String lockValue = ops.get("lock");

String script = "if redis.call(\"get\",KEYS[1]) == ARGV[1] then\n" +

" return redis.call(\"del\",KEYS[1])\n" +

"else\n" +

" return 0\n" +

"end";

stringRedisTemplate.execute(

new DefaultRedisScript<Long>(script, Long.class),

Arrays.asList("lock"),

lockValue);

return categoriesDb;

}else {

try {

Thread.sleep(100);

} catch (InterruptedException e) {

e.printStackTrace();

}

return getCatalogJsonDbWithRedisLock();

}

}

|

Redisson

上面的lua脚本写法每次用分布式锁时比较麻烦,我们可以采用redisson现有框架

https://redis.io/topics/distlock

Redisson

https://github.com/redisson/redisson

Redisson是一个在Redis的基础上实现的Java驻内存数据网格(In-Memory Data Grid)。它不仅提供了一系列的分布式的Java常用对象,还提供了许多分布式服务。其中包括(BitSet, Set, Multimap, SortedSet, Map, List, Queue, BlockingQueue, Deque, BlockingDeque, Semaphore, Lock, AtomicLong, CountDownLatch, Publish / Subscribe, Bloom filter, Remote service, Spring cache, Executor service, Live Object service, Scheduler service) Redisson提供了使用Redis的最简单和最便捷的方法。Redisson的宗旨是促进使用者对Redis的关注分离(Separation of Concern),从而让使用者能够将精力更集中地放在处理业务逻辑上。

本文我们仅关注分布式锁的实现,更多请参考官方文档

环境搭建

导入依赖

1

2

3

4

5

| <dependency>

<groupId>org.redisson</groupId>

<artifactId>redisson</artifactId>

<version>3.13.4</version>

</dependency>

|

这个用作练习,后面可以使用redisson-spring-boot-starter

开启配置https://github.com/redisson/redisson/wiki/2.-%E9%85%8D%E7%BD%AE%E6%96%B9%E6%B3%95

1

2

3

4

5

6

7

8

9

10

11

12

13

14

| @Configuration

public class MyRedisConfig {

@Value("${ipAddr}")

private String ipAddr;

@Bean(destroyMethod = "shutdown")

public RedissonClient redisson() {

Config config = new Config();

config.useSingleServer().setAddress("redis://" + ipAddr + ":6379");

return Redisson.create(config);

}

}

|

可重入锁(Reentrant Lock)

分布式锁:文档

A调用B。AB都需要同一锁,此时可重入锁就可以重入,A就可以调用B。不可重入锁时,A调用B将死锁

1

2

3

4

5

|

RLock lock = redissonClient.getLock("CatalogJson-Lock");

lock.lock();

lock.unlock();

|

基于Redis的Redisson分布式可重入锁RLock Java对象实现了java.util.concurrent.locks.Lock接口。同时还提供了异步(Async)、反射式(Reactive)和RxJava2标准的接口。

锁的续期:大家都知道,如果负责储存这个分布式锁的Redisson节点宕机以后,而且这个锁正好处于锁住的状态时,这个锁会出现锁死的状态。为了避免这种情况的发生,Redisson内部提供了一个监控锁的看门狗,它的作用是在Redisson实例被关闭前,不断的延长锁的有效期。默认情况下,看门狗的检查锁的超时时间是30秒钟(每到20s就会自动续借成30s,是1/3的关系),也可以通过修改Config.lockWatchdogTimeout来另行指定。

另外Redisson还通过加锁的方法提供了leaseTime的参数来指定加锁的时间。超过这个时间后锁便自动解开了。

1

2

3

4

5

6

7

8

9

10

11

12

13

|

lock.lock(10, TimeUnit.SECONDS);

boolean res = lock.tryLock(100, 10, TimeUnit.SECONDS);

if (res) {

try {

...

} finally {

lock.unlock();

}

}

|

如果传递了锁的超时时间,就执行脚本,进行占锁;

如果没传递锁时间,使用看门狗的时间,占锁。如果返回占锁成功future,调用future.onComplete();

没异常的话调用scheduleExpirationRenewal(threadId);

重新设置过期时间,定时任务;

看门狗的原理是定时任务:重新给锁设置过期时间,新的过期时间就是看门狗的默认时间;

锁时间/3是定时任务周期;

Redisson同时还为分布式锁提供了异步执行的相关方法:

1

2

3

4

| RLock lock = redisson.getLock("anyLock");

lock.lockAsync();

lock.lockAsync(10, TimeUnit.SECONDS);

Future<Boolean> res = lock.tryLockAsync(100, 10, TimeUnit.SECONDS);

|

RLock对象完全符合Java的Lock规范。也就是说只有拥有锁的进程才能解锁,其他进程解锁则会抛出IllegalMonitorStateException错误。但是如果遇到需要其他进程也能解锁的情况,请使用分布式信号量Semaphore 对象.

gulimall项目中获取二三级分类json数据的分布式锁demo:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

| public Map<String, List<Catalog2Vo>> getCatalogJsonDbWithRedisson() {

Map<String, List<Catalog2Vo>> categoryMap=null;

RLock lock = redissonClient.getLock("CatalogJson-Lock");

lock.lock();

try {

Thread.sleep(30000);

categoryMap = getCategoryMap();

} catch (InterruptedException e) {

e.printStackTrace();

}finally {

lock.unlock();

return categoryMap;

}

}

|

最佳实战:自己指定锁时间,时间长点即可

读写锁(ReadWriteLock)

基于Redis的Redisson分布式可重入读写锁RReadWriteLock Java对象实现了java.util.concurrent.locks.ReadWriteLock接口。其中读锁和写锁都继承了RLock接口。

分布式可重入读写锁允许同时有多个读锁和一个写锁处于加锁状态。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

| RReadWriteLock rwlock = redisson.getReadWriteLock("anyRWLock");

rwlock.readLock().lock();

rwlock.writeLock().lock();

rwlock.readLock().lock(10, TimeUnit.SECONDS);

rwlock.writeLock().lock(10, TimeUnit.SECONDS);

boolean res = rwlock.readLock().tryLock(100, 10, TimeUnit.SECONDS);

boolean res = rwlock.writeLock().tryLock(100, 10, TimeUnit.SECONDS);

...

lock.unlock();

|

信号量(Semaphore)

信号量为存储在redis中的一个数字,当这个数字大于0时,即可以调用acquire()方法增加数量,也可以调用release()方法减少数量,但是当调用release()之后小于0的话方法就会阻塞,直到数字大于0

基于Redis的Redisson的分布式信号量(Semaphore)Java对象RSemaphore采用了与java.util.concurrent.Semaphore相似的接口和用法。同时还提供了异步(Async)、反射式(Reactive)和RxJava2标准的接口。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

| RSemaphore semaphore = redisson.getSemaphore("semaphore");

semaphore.acquire();

semaphore.acquireAsync();

semaphore.acquire(23);

semaphore.tryAcquire();

semaphore.tryAcquireAsync();

semaphore.tryAcquire(23, TimeUnit.SECONDS);

semaphore.tryAcquireAsync(23, TimeUnit.SECONDS);

semaphore.release(10);

semaphore.release();

semaphore.releaseAsync();

|

spring项目demo:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

| @GetMapping("/park")

@ResponseBody

public String park() {

RSemaphore park = redissonClient.getSemaphore("park");

try {

park.acquire(2);

} catch (InterruptedException e) {

e.printStackTrace();

}

return "停进2";

}

@GetMapping("/go")

@ResponseBody

public String go() {

RSemaphore park = redissonClient.getSemaphore("park");

park.release(2);

return "开走2";

}

|

闭锁(CountDownLatch)

基于Redisson的Redisson分布式闭锁(CountDownLatch)Java对象RCountDownLatch采用了与java.util.concurrent.CountDownLatch相似的接口和用法。

以下代码只有offLatch()被调用5次后 setLatch()才能继续执行

1

2

3

4

5

6

7

| RCountDownLatch latch = redisson.getCountDownLatch("anyCountDownLatch");

latch.trySetCount(5);

latch.await();

RCountDownLatch latch = redisson.getCountDownLatch("anyCountDownLatch");

latch.countDown();

|

缓存和数据库一致性

解决一致性的两种模式:

一致性解决方案:

- 如果是用户纬度数据(订单数据、用户数据),这种并发几率非常小,不用考虑这个问题(一致性),缓存数据加上过期时间,每隔一段时间触发读的主动更新即可。

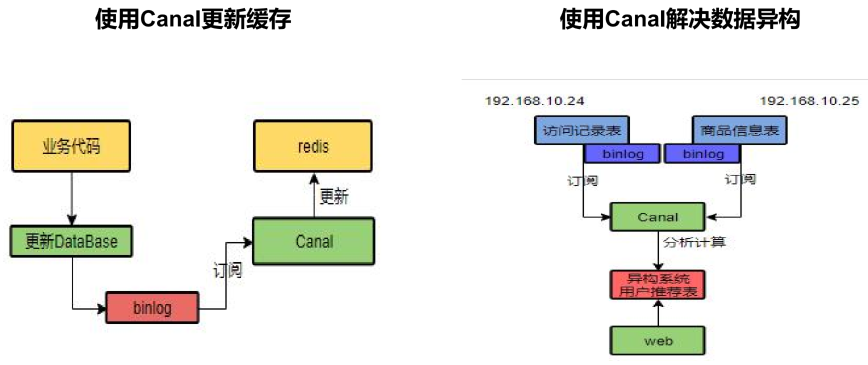

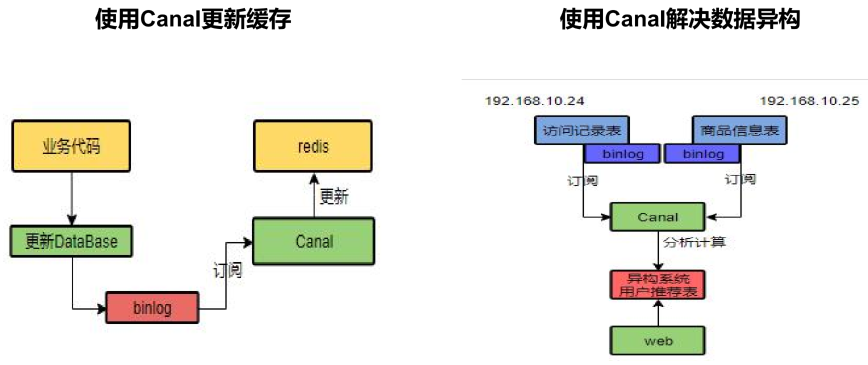

- 如果是菜单,商品介绍等基础数据,也可以去使用canal订阅binlog的方式(参见下图)

- 缓存数据+过期时间也足够解决大部分业务对于缓存的要求。

- 通过加锁保证并发读写,写写的时候按顺序排好队。读读无所谓。所以适合使用读写锁。(业务不关心脏数据,允许临时脏数据可忽略);

总结:

我们能放入缓存的数据本就不应该是实时性、一致性要求超高的。所以缓存数据的时候加上过期时间,保证每天拿到当前最新数据即可。

我们不应该过度设计,增加系统的复杂性。遇到实时性、一致性要求高的数据,就应该查数据库,即使慢点。

SpringCache

每次都像之前说的那样直接调用redisclient操作缓存太麻烦了,spring从3.1开始定义了Cache、CacheManager接口来统一不同的缓存技术。并支持使用JCache(JSR-107)注解简化我们的开发

Cache接口的实现包括RedisCache、EhCacheCache、ConcurrentMapCache等

每次调用需要缓存功能的方法时,spring会检查检查指定参数的指定的目标方法是否已经被调用过;如果有就直接从缓存中获取方法调用后的结果,如果没有就调用方法并缓存结果后返回给用户。下次调用直接从缓存中获取。

使用Spring缓存抽象时我们需要关注以下两点:

1、确定方法需要缓存以及他们的缓存策略

2、从缓存中读取之前缓存存储的数据

配置依赖

1

2

3

4

| <dependency>

<groupId>org.springframework.b oot</groupId>

<artifactId>spring-boot-starter-cache</artifactId>

</dependency>

|

指定缓存类型并在主配置类上加上注解@EnableCaching

1

2

3

4

5

6

7

| spring:

cache:

type: redis

redis:

time-to-live: 360000

cache-null-values: true

|

springcache默认使用jdk进行序列化(可读性差),默认ttl为-1永不过期,自定义序列化方式需要编写配置类

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

| @Configuration

public class MyCacheConfig {

@Bean

RedisCacheConfiguration redisCacheConfiguration(CacheProperties cacheProperties){

RedisCacheConfiguration config = RedisCacheConfiguration.defaultCacheConfig();

config = config.serializeKeysWith(RedisSerializationContext.SerializationPair.fromSerializer(new StringRedisSerializer()));

config = config.serializeValuesWith(RedisSerializationContext.SerializationPair.fromSerializer(new GenericJackson2JsonRedisSerializer()));

CacheProperties.Redis redisProperties = cacheProperties.getRedis();

if (redisProperties.getTimeToLive() != null) {

config = config.entryTtl(redisProperties.getTimeToLive());

}

if (redisProperties.getKeyPrefix() != null) {

config = config.prefixKeysWith(redisProperties.getKeyPrefix());

}

if (!redisProperties.isCacheNullValues()) {

config = config.disableCachingNullValues();

}

if (!redisProperties.isUseKeyPrefix()) {

config = config.disableKeyPrefix();

}

return config;

}

}

|

springcache的自动配置

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

|

@Configuration(proxyBeanMethods = false)

@ConditionalOnClass(CacheManager.class)

@ConditionalOnBean(CacheAspectSupport.class)

@ConditionalOnMissingBean(value = CacheManager.class, name = "cacheResolver")

@EnableConfigurationProperties(CacheProperties.class)

@AutoConfigureAfter({ CouchbaseAutoConfiguration.class, HazelcastAutoConfiguration.class,

HibernateJpaAutoConfiguration.class, RedisAutoConfiguration.class })

@Import({ CacheConfigurationImportSelector.class, // 看导入什么CacheConfiguration

CacheManagerEntityManagerFactoryDependsOnPostProcessor.class })

public class CacheAutoConfiguration {

@Bean

@ConditionalOnMissingBean

public CacheManagerCustomizers cacheManagerCustomizers(ObjectProvider<CacheManagerCustomizer<?>> customizers) {

return new CacheManagerCustomizers(customizers.orderedStream().collect(Collectors.toList()));

}

@Bean

public CacheManagerValidator cacheAutoConfigurationValidator(CacheProperties cacheProperties,

ObjectProvider<CacheManager> cacheManager) {

return new CacheManagerValidator(cacheProperties, cacheManager);

}

@ConditionalOnClass(LocalContainerEntityManagerFactoryBean.class)

@ConditionalOnBean(AbstractEntityManagerFactoryBean.class)

static class CacheManagerEntityManagerFactoryDependsOnPostProcessor

extends EntityManagerFactoryDependsOnPostProcessor {

CacheManagerEntityManagerFactoryDependsOnPostProcessor() {

super("cacheManager");

}

}

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

| @Configuration(proxyBeanMethods = false)

@ConditionalOnClass(RedisConnectionFactory.class)

@AutoConfigureAfter(RedisAutoConfiguration.class)

@ConditionalOnBean(RedisConnectionFactory.class)

@ConditionalOnMissingBean(CacheManager.class)

@Conditional(CacheCondition.class)

class RedisCacheConfiguration {

@Bean

RedisCacheManager cacheManager(CacheProperties cacheProperties,

CacheManagerCustomizers cacheManagerCustomizers,

ObjectProvider<org.springframework.data.redis.cache.RedisCacheConfiguration> redisCacheConfiguration,

ObjectProvider<RedisCacheManagerBuilderCustomizer> redisCacheManagerBuilderCustomizers,

RedisConnectionFactory redisConnectionFactory, ResourceLoader resourceLoader) {

RedisCacheManagerBuilder builder = RedisCacheManager.builder(redisConnectionFactory).cacheDefaults(

determineConfiguration(cacheProperties, redisCacheConfiguration, resourceLoader.getClassLoader()));

List<String> cacheNames = cacheProperties.getCacheNames();

if (!cacheNames.isEmpty()) {

builder.initialCacheNames(new LinkedHashSet<>(cacheNames));

}

redisCacheManagerBuilderCustomizers.orderedStream().forEach((customizer) -> customizer.customize(builder));

return cacheManagerCustomizers.customize(builder.build());

}

|

缓存使用@Cacheable@CacheEvict

第一个方法存放缓存,第二个方法清空缓存

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

|

@Cacheable(value = {"category"},key = "#root.methodName",sync = true)

public Map<String, List<Catalog2Vo>> getCatalogJsonDbWithSpringCache() {

return getCategoriesDb();

}

@Override

@CacheEvict(value = {"category"},allEntries = true)

public void updateCascade(CategoryEntity category) {

this.updateById(category);

if (!StringUtils.isEmpty(category.getName())) {

categoryBrandRelationService.updateCategory(category);

}

}

如果要清空多个缓存,用@Caching(evict={@CacheEvict(value="")})

或使用@CacheEvict(value = {"category"}, allEntries = true),该注解能让该方法清除名称为category的缓存下的所有缓存

|

SpringCache原理与不足

读模式

- 缓存穿透:查询一个null数据。解决方案:缓存空数据,可通过spring.cache.redis.cache-null-values=true

- 缓存击穿:大量并发进来同时查询一个正好过期的数据。解决方案:加锁 ? 默认是无加锁的;

使用sync = true来解决击穿问题

- 缓存雪崩:大量的key同时过期。解决:加随机时间。

写模式:(缓存与数据库一致)

- 读写加锁。

- 引入Canal,感知到MySQL的更新去更新Redis

- 读多写多,直接去数据库查询就行

总结:

常规数据(读多写少,即时性,一致性要求不高的数据,完全可以使用Spring-Cache):

写模式(只要缓存的数据有过期时间就足够了)

特殊数据:特殊设计